Lorsque les développeurs sur Twitter et Hacker News se sont emballés pour le framework open source OpenClaw, un schéma a rapidement émergé. Les réseaux sociaux se sont remplis de photos d’ordinateurs autonomes capables d’exécuter des commandes shell, de réaliser des transactions automatiquement ou encore de gérer des boîtes mail sans intervention humaine. Dans de nombreux cas, ces machines étaient constituées de groupes de Mac Mini. Très vite, le Mac Mini s’est imposé comme le matériel de référence pour celles et ceux qui souhaitent créer un assistant IA fonctionnant en continu. Mais dans cet enthousiasme, une question essentielle a souvent été mise de côté : est-ce vraiment le bon choix pour tout le monde ?

La réponse est plus nuancée qu’il n’y paraît. Le Mac Mini présente de vrais atouts, mais aussi des limites souvent sous-estimées. Dans cet article, nous comparons le Mac Mini à la nouvelle génération de mini PC x86 performants, en nous basant sur plusieurs critères clés : les performances, le prix, la confidentialité, la capacité à exécuter des LLM en local, ainsi que la fiabilité en fonctionnement 24/7. L’objectif : vous aider à déterminer quelle plateforme offre réellement le meilleur point de départ pour vos projets OpenClaw.

Vous voulez aller droit au but ? Consultez directement le tableau récapitulatif à la fin.

De quel matériel OpenClaw a-t-il réellement besoin ?

Le framework OpenClaw en lui-même est étonnamment léger. Ce n’est pas l’agent qui dicte les besoins matériels, mais bien votre usage concret. Avant de comparer les options matérielles, il est donc essentiel de comprendre quel type d’utilisateur OpenClaw vous êtes.

On distingue principalement trois profils :

|

Utilisateur API Cloud

Appel de modèles externes via API

Vous utilisez principalement OpenClaw pour vous connecter à des modèles d’IA hébergés — comme OpenAI, Anthropic ou d’autres services similaires — sans rien faire tourner en local. Votre machine joue le rôle de coordinateur fiable, et non de moteur de calcul.

Ce qui compte avant tout

– Une connexion internet stable et permanente

– Une disponibilité constante — les pics de latence sont votre principal ennemi – Une RAM modeste (16 Go est généralement suffisant) – Une consommation électrique réduite au repos pour un fonctionnement 24h/24 |

Utilisateur LLM local

Exécution des modèles en local

Vous souhaitez garder le contrôle total : aucune donnée ne quitte votre réseau, pas d’abonnement, et aucune dépendance à la disponibilité d’un service tiers. Que ce soit pour des raisons de conformité RGPD, d’économies à long terme ou pour travailler hors ligne, vous faites tourner le modèle vous-même.

Ce qui compte avant tout

– Une grande capacité RAM (32 Go minimum ; 64–128 Go idéal pour les modèles 13B+)

– Un GPU ou NPU performant pour l’inférence – De bonnes performances thermiques soutenues sous charge – La compatibilité Linux pour les outils open source |

Utilisateur Agent en continu

Des agents actifs en permanence

Vous avez besoin qu’au moins un agent tourne en continu — pour surveiller votre domotique, gérer le tri des e-mails ou exécuter des tâches répétitives en arrière-plan. Pensez-y moins comme à un poste de travail que comme à un appareil discret qui ronronne tranquillement dans un coin du salon.

Ce qui compte avant tout

– Une consommation électrique faible et prévisible (la facture EDF s’accumule vite)

– Un refroidissement passif ou quasi-silencieux en charge normale – Une stabilité matérielle sur la durée — pas seulement les performances en pic – La gestion fiable des tâches planifiées (cron, systemd timers) |

Cette distinction est essentielle. Si votre objectif est simplement d’utiliser OpenClaw avec des API cloud, un mini PC équipé de 16 Go de RAM et correctement configuré sera largement suffisant. Inutile d’investir plus de 1 000 $ dans une machine dont vous n’exploiterez jamais réellement le potentiel.

Les véritables points forts du Mac Mini pour OpenClaw

C’est pour ces raisons que le Mac Mini M4 s’est imposé comme un standard. Il offre de nombreux avantages concrets qui en font un excellent choix, notamment pour les utilisateurs déjà intégrés dans l’écosystème Apple.

Les puces Apple M-series excellent dans les tâches mono-thread et offrent une excellente réactivité face aux requêtes d’un agent. D’après des analyses approfondies de sites spécialisés comme AnandTech, cela signifie que les tâches nécessitant un cœur rapide s’exécutent très rapidement. Concrètement, un agent IA peut prendre des décisions plus vite et avancer plus efficacement dans des tâches complexes.

Le Mac Mini dispose également d’un avantage moins visible mais essentiel : son silence et sa gestion thermique. Même sous forte charge, il reste discret et maintient ses performances grâce à un système de refroidissement particulièrement bien conçu. C’est un atout majeur pour faire tourner un agent 24/7 à domicile ou au bureau sans nuisance sonore.

Autre point fort : son intégration poussée avec l’écosystème Apple. Le Mac Mini permet une interaction fluide avec des services comme iMessage, FaceTime et d’autres outils natifs. Pour de nombreux utilisateurs, cet aspect est difficile à remplacer.

Prix d’entrée accessible : Le modèle de base du Mac Mini M4 constitue une porte d’entrée relativement abordable dans l’univers Apple. Il offre de bonnes performances pour son prix, en particulier pour les utilisateurs ayant des besoins modestes, comme une configuration avec 8 Go de RAM.

Cliquez ici pour en savoir plus sur le test du Test Mac Mini : Performance et Fonctionnalité Déballée

Les limites cachées du Mac Mini pour les workloads IA

Malgré ses qualités, le Mac Mini présente aussi des limitations importantes, notamment pour les usages liés à l’IA et au développement.

La mémoire RAM est soudée à la carte mère, ce qui rend toute évolution impossible après l’achat. Vous devez donc choisir dès le départ la configuration adaptée, sous peine de vous retrouver rapidement limité. Or, les options de RAM chez Apple sont connues pour être coûteuses (par exemple, environ €200 supplémentaires pour chaque tranche de 8 Go). Cela peut vite devenir un frein si vous souhaitez exécuter des LLM en local.

Même constat pour le stockage : il n’est pas possible d’augmenter la capacité interne après achat. Bien qu’il soit possible d’utiliser des solutions externes, cela complique l’installation et alourdit l’environnement de travail. Le stockage interne reste à la fois limité et onéreux, ce qui peut poser problème pour gérer de gros datasets ou des checkpoints de modèles.

Côté système, l’utilisation de Linux reste encore limitée sur Apple Silicon. Malgré les progrès réalisés par des projets comme Asahi Linux, l’écosystème reste moins mature que sur architecture x86. De nombreux outils natifs, images Docker et compatibilités matérielles disponibles sur PC classique ne sont pas toujours accessibles. Pour certains profils, cela peut représenter un frein important.

Enfin, le Mac Mini ne dispose que d’un seul port Ethernet, sans possibilité de configuration dual LAN. Cela peut poser des problèmes en matière de sécurité et de segmentation réseau. Sans second port, il devient plus difficile de mettre en place un pare-feu physique ou d’isoler différents environnements réseau. C’est un point crucial pour les utilisateurs souhaitant créer un home lab sécurisé ou une infrastructure self-hosted, d’autant que cette fonctionnalité est déjà présente sur de nombreux mini PC orientés développement.

Pourquoi les mini PC x86 offrent plus de flexibilité pour les utilisateurs d’OpenClaw

Les mini PC basés sur une architecture x86, comme ceux proposés par GEEKOM, constituent une alternative particulièrement intéressante. Leur approche repose sur une architecture ouverte, qui privilégie la flexibilité, l’évolutivité et le rapport qualité/prix.

Leur principal atout réside dans leur excellent rapport performances/prix. De nombreux mini PC GEEKOM sont proposés à un tarif inférieur à celui du Mac Mini d’entrée de gamme, tout en offrant deux fois plus de RAM et de stockage. Et surtout, ces composants sont évolutifs, ce qui permet d’adapter la machine à vos besoins dans le temps.

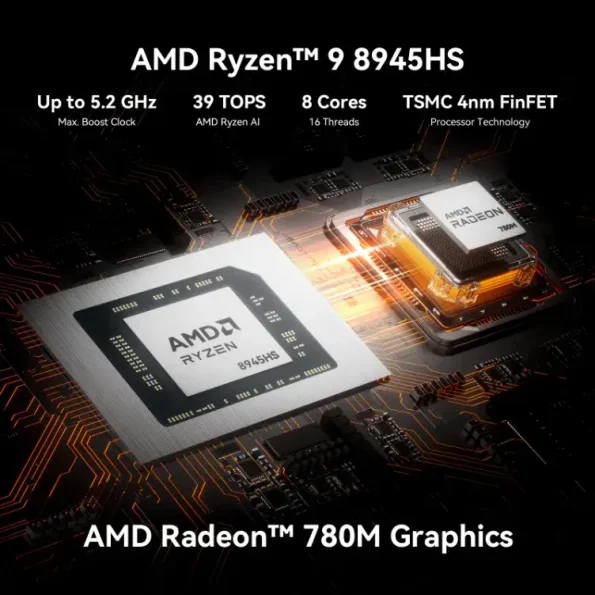

Si vous souhaitez simplement tester OpenClaw, le GEEKOM A8 Max représente l’un des meilleurs choix en termes de rapport qualité/prix, notamment pour les utilisateurs d’API cloud. Il est nettement plus abordable qu’un Mac Mini tout en embarquant un processeur AMD Ryzen™ 7 8745HS, jusqu’à 64 Go de RAM DDR5 évolutive, ainsi que deux ports LAN 2.5G.

Pour les utilisateurs souhaitant exécuter OpenClaw avec des modèles LLM en local, le GEEKOM A9 Max s’impose comme une option plus adaptée. Conçu pour les usages avancés, il intègre un processeur AMD Ryzen AI 9 HX 370 capable de dépasser les 50 TOPS, ce qui permet d’accélérer les tâches d’inférence. Il peut également accueillir jusqu’à 128 Go de RAM DDR5, une capacité idéale pour exécuter des modèles de 7B à 13B de paramètres.

Le GEEKOM A9 Mega va encore plus loin. Il s’adresse aux développeurs qui souhaitent créer leurs propres applications IA ou exécuter plusieurs modèles localement. Grâce à un processeur de dernière génération dépassant les 126 TOPS, un Radeon 890M et la prise en charge de quatre écrans 8K, il est parfaitement adapté aux charges de travail lourdes en inférence locale et en développement IA.

Matériel OpenClaw : quelle configuration choisir ?

Le tableau ci-dessous permet d’identifier rapidement la configuration la plus adaptée en fonction de votre usage d’OpenClaw.

| Cas d’usage | Recommandation | Pourquoi |

|---|---|---|

| API cloud uniquement, budget limité | GEEKOM A8 Max | 32 Go de RAM évolutive, double LAN, à partir de moins de 750 $ |

| iMessage indispensable | Mac Mini M4 | Seule plateforme offrant une intégration native d’iMessage avec OpenClaw |

| OpenClaw + modèles locaux 7B–13B | GEEKOM A9 Max | NPU 50 TOPS, jusqu’à 128 Go DDR5, performances validées en tests |

| Inférence locale intensive / développement IA | GEEKOM A9 Mega | 126 TOPS, Radeon 8060S, support de 4 écrans 8K |

| Fonctionnement silencieux 24/7, faible consommation | Mac Mini M4 | Excellentes performances thermiques et acoustiques dans sa catégorie |

| Confidentialité maximale / conformité RGPD (UE) | GEEKOM + Linux | Exécution 100 % locale, sans dépendance à l’écosystème Apple, avec contrôle total des données |

La question clé qui détermine votre matériel OpenClaw

Une question étonnamment simple permet de trancher entre un Mac Mini et un mini PC GEEKOM pour votre configuration OpenClaw : avez-vous besoin d’une intégration native d’iMessage ?

Si la réponse est oui, le choix est vite fait. Le Mac Mini est aujourd’hui le seul appareil capable de proposer cette intégration, ce qui met fin au débat pour de nombreux utilisateurs.

En revanche, si la réponse est non, vous ouvrez la porte à beaucoup plus de flexibilité et à un meilleur rapport qualité/prix. Vous pouvez opter pour un mini PC GEEKOM, souvent moins cher qu’un Mac Mini, tout en bénéficiant de 32 Go, 64 Go voire 128 Go de RAM DDR5 évolutive, de deux ports LAN 2.5G pour des configurations réseau avancées, ainsi que de la liberté d’installer la distribution Linux de votre choix. Certes, vous renoncez à iMessage, mais si vous utilisez principalement WhatsApp, Telegram, Slack ou Discord pour communiquer, ce compromis est largement compensé par le gain en puissance, en évolutivité et en contrôle.

Prêt à créer votre configuration OpenClaw en fonctionnement continu ? Découvrez le GEEKOM A9 Max ou optez directement pour le GEEKOM A9 Mega pour une configuration encore plus avancée.

Geekom

GEEKOM a établi son siège de recherche et développement à Taïwan et possède plusieurs filiales dans de nombreux pays à travers le monde. Les membres de notre équipe centrale sont les piliers techniques ayant déjà travaillé chez Inventec, Quanta et d'autres entreprises renommées. Nous possédons des capacités solides en matière de R&D et d'innovation. Nous nous efforçons constamment d'atteindre l'excellence dans le domaine des produits technologiques.